Inteligencia artificial

- Kryathos

- Teniente Primero

- Mensajes: 1746

- Registrado: Jue Feb 11, 2010 9:49 pm

- Ubicación: Weón la weá

- Edad: 27

- Género:

Re: Inteligencia artificial

@BF-37

Si el debate es sobre qué es real y qué no lo es mejor llamemos a un admin para que cierre el tema, porque llegar a una respuesta es imposible. Cito a VSauce: «¿Conoceremos algún día la realidad verdadera, o estamos atrapados en un mundo donde sólo podemos aproximarnos a ella? Descubrimos más y más teorías útiles todos los días, pero nunca llegamos a la realidad objetiva verdadera. ¿Puede la ciencia o la razón probar alguna vez, de manera convincente, de que todo lo que vemos existe más allá de nuestra mente? No.». Hay teorías que hablan sobre que vivimos en la Matrix, inclusive una que habla sobre la posibilidad de que el universo haya sido creado el jueves pasado. Ambas quizás muy absurdas, pero... ¿acaso se puede probar lo contrario?

Dejo el vídeo, no tiene desperdicio.

Si el debate es sobre qué es real y qué no lo es mejor llamemos a un admin para que cierre el tema, porque llegar a una respuesta es imposible. Cito a VSauce: «¿Conoceremos algún día la realidad verdadera, o estamos atrapados en un mundo donde sólo podemos aproximarnos a ella? Descubrimos más y más teorías útiles todos los días, pero nunca llegamos a la realidad objetiva verdadera. ¿Puede la ciencia o la razón probar alguna vez, de manera convincente, de que todo lo que vemos existe más allá de nuestra mente? No.». Hay teorías que hablan sobre que vivimos en la Matrix, inclusive una que habla sobre la posibilidad de que el universo haya sido creado el jueves pasado. Ambas quizás muy absurdas, pero... ¿acaso se puede probar lo contrario?

Dejo el vídeo, no tiene desperdicio.

- Gafas D Kuro

- Comandante

- Mensajes: 2626

- Registrado: Mié Feb 27, 2013 2:46 pm

- Ubicación: On the napia.

- Edad: 34

Re: Inteligencia artificial

Pero es que precisamente la electrónica no consiste en simples metales, sino que entramos ya en el terreno de los semiconductores. Lo que la bioquímica filtra mediante enzimas, reacciones químicas y demás la electrónica lo hace mediante código y matemáticas; distintos medios para una misma finalidad: la de distribuir información y procesar respuestas para dirigir el funcionamiento de un complejo sistema mecánico. Te compro que actualmente la bioquímica esta a pársecs de distancia de lo que se puede hacer dopando silicio o, con suerte, con otros semiconductores como el grafeno o el nitruro de galio; pero es que comparar algo que se ha estado gestando durante centenares de millones de años con una tecnología de apenas un siglo de vida (que ha crecido rapidísimamente, eso sí) no es justo, todavía hay que dejarla crecer. Es como pretender producir una fusión nuclear con tecnologías basadas en el vapor porque hace 200 años lo que se llevaba era eso: la máquina de vapor. No, aún hay mucho margen para más revoluciones en la miniaturización (¿sabes lo que son los MEMS?), la ciencia de materiales o el tratamiento matemático de datos. Veremos entonces si producir organismos artificiales realmente parece imposible.Gromio D Gonz escribió:Por lo que he explicado. La bioquímica es muy diferente de la quimica, y un monton de cables y metales jamás van a llegar ni de lejos al metabolismo bioquimico y fisiologico que conforma la vida tal y como conocemos.LasGafasDeKuro escribió:¿Por qué una máquina no va a tener química real cuando precisamente toda la electrónica en la que se basa su funcionamiento es una aplicación directísima de la química? ¿Qué problema hay en que no haya neuronas reales si la función principal de éstas es la transmisión de señales eléctricas (creo que todos damos por hecho que una máquina está llena de cables u otros medios de transmisión)?

Tan solo llegará a un software y una emulacion, con un programa que haga que presente un comportamiento que ha nosotros nos parecerá muy humano.

Como dije, sin una definición más exacta del susodicho "robot humanizado" del que se está hablando no creo que se llegue a ninguna parte con la discusión, ya que hablamos de algo que no existe y que apenas imaginamos como sería si llegara a existir.

Esgrimes que las neuronas son sistemas vivos más pequeños y especializados, como si en un futuro la electrónica no pudiera estar a su vez descentralizada y convertir cada nodo en un rico procesador con rutinas bien calculadas y depuradas para cumplir con su propósito específico dentro de un sistema de propósito general. Para comprobar el potencial es mejor comparar ambas tecnologías en una fase de desarrollo similar así que yo propongo otra cuestión ¿sería posible producir un sistema artificial que se comportase de manera idéntica a una ameba?

P.D.- El término correcto es algoritmo, los logaritmos son para los decibelios.

- Spoiler: Mostrar

Re: Inteligencia artificial

Es que encima el solipsismo (sólo existo yo) es otra posibilidad, en mi opinión indemostrable, pero también irrefutable, luego se ha de contar como una opción que puede ser la verdadera realidad.Kryathos escribió:@BF-37

Si el debate es sobre qué es real y qué no lo es mejor llamemos a un admin para que cierre el tema, porque llegar a una respuesta es imposible. Cito a VSauce: «¿Conoceremos algún día la realidad verdadera, o estamos atrapados en un mundo donde sólo podemos aproximarnos a ella? Descubrimos más y más teorías útiles todos los días, pero nunca llegamos a la realidad objetiva verdadera. ¿Puede la ciencia o la razón probar alguna vez, de manera convincente, de que todo lo que vemos existe más allá de nuestra mente? No.». Hay teorías que hablan sobre que vivimos en la Matrix, inclusive una que habla sobre la posibilidad de que el universo haya sido creado el jueves pasado. Ambas quizás muy absurdas, pero... ¿acaso se puede probar lo contrario?

Dejo el vídeo, no tiene desperdicio.

Recomiendo leer los argumentos de la simulación, porque básicamente, cierran las puertas a casi cualquier otra posibilidad:

https://es.wikipedia.org/wiki/Hip%C3%B3 ... aci%C3%B3n

Y una cuestión muy interesante es: Si el universo hubiera sido creado el jueves pasado, como dices, y desde el mismo momento de nuestra creación se nos hubieran implantado los recuerdos que poseemos actualmente. Bien, creo que todos damos por hecho que no porque el universo haya sido creado hace poco y nuestros recuerdos hayan sido implantados, estos serán menos vívidos y reales que los experimentados en una fecha posterior a la "creación" de este universo.

Por lo tanto, si nosostros recordamos con certeza indiscutible nuestro propio pasado anterior a la creación de nuestro universo, es esa experiencia recordada equivalente a haberla vivido realmente, y al haberla vivido realmente, tiene que haber existido un universo donde esos acontecimientos hayan existido efectivamente, por lo tanto:

En un universo creado artificialmente, todos los recuerdos implantados en las personas que hayan sido creadas en el momento del inicio efectivo de la simulación, crean un pasado real de ese universo hasta el momento de su nacimiento "real".

Y al existir el universo simulado antes de haber comenzado la simulación (sí, es causalidad funcionando en sentido contrario) un universo simulado sería real a la vez que simulado.

PD: LasGafasDeKuro: Creo que de hecho ya se estaban tratando de simular mediante pura IA el comportamiento del cerebro de una rata.

PD2: http://www.eliax.com/?post_id=4234 De momento está claro que es extremadamente ineficiente, pero ya se van dando pasos.

Asociación por el retorno del rostro y personalidad de Nico Robin original, así como de los demás personajes.

Mala persona oficial del foro. Adorador de Satán

- Kryathos

- Teniente Primero

- Mensajes: 1746

- Registrado: Jue Feb 11, 2010 9:49 pm

- Ubicación: Weón la weá

- Edad: 27

- Género:

Re: Inteligencia artificial

Al fin y al cabo, todo lo que conocemos y creemos saber no es más que información retenida de alguna forma en nuestro cerebro. Estamos totalmente solos con nuestros pensamientos. Pero vamos, centrémonos en los robots y no en nuestra percepciones xD

Ya verán cómo las ratas nos dominarán a todos. Goosebumps ya dijo en su día que serían las hormigas, pero se equivocaban!! Serán las ratas!!!BF-37 escribió:PD2: http://www.eliax.com/?post_id=4234 De momento está claro que es extremadamente ineficiente, pero ya se van dando pasos.

- Gafas D Kuro

- Comandante

- Mensajes: 2626

- Registrado: Mié Feb 27, 2013 2:46 pm

- Ubicación: On the napia.

- Edad: 34

Re: Inteligencia artificial

Pero con lo de la ameba quiero ir más allá. No hablo de simular un cerebro, sino de un completo sistema que se comporte exactamente igual... bueno, igual en todo salvo en la reproducción, naturalmente. Un diminuto robot que busque un determinado tipo de alimento comunicándose de algún modo con su entorno, se desplace hacia él con un sistema muy primitivo de movimiento y una vez obtenido dicho alimento lo procese y deseche alguna porción sobrante.BF-37 escribió:PD: LasGafasDeKuro: Creo que de hecho ya se estaban tratando de simular mediante pura IA el comportamiento del cerebro de una rata.

Habría diferencias con una ameba real ya que un robot no tiene capacidad de crecimiento y, por lo tanto, no necesitaría más que energía; pero es que la idea es: si bien la forma de vida es muy distinta, al menos no se niega la capacidad de actuar de un modo similar. Y a partir de ahí ir escalando a formas de vida más complejas, imitando su estructura interna y sus motivaciones.

- Spoiler: Mostrar

Re: Inteligencia artificial

@BF-37:

Muy interesante. Continuaré con mi post.

Para implementar una cosa a algo, debes conocer al 100% esa cosa. Si no, no es ni será lo mismo. Supongo que estamos de acuerdo, sigamos.

Está más que probado que el ser humano en cuanto tiene la facilidad/capacidad del habla deja de usar una parte importante de su cerebro. Deja "ver" las cosas como son y las ve como algo en plan "lo que me han dicho que está" y busca soluciones rápidas y efectivas a sus problemas. No se para a pensar las soluciones alternativas. El cerebro se convierte en una máquina que soluciona todos los problemas.

Los que hayan estudiado arte o estén interesados en este campo, saben que estamos "desaprendiendo" todo lo que hemos ido creyendo que era así. La gente que está en su día a día sin prestar atención a nada, son incapaces de percibir ciertas cosas que a través de un proceso de desaprendizaje, se consigue.

Un ejemplo muy notorio son las personas ciegas que han desarrollado sus otros sentidos fuera de lo normal y científicos llevan estudiando esto desde hace siglos y no dan con la clave de por qué, si es por evolución, si es por algo interno, etc.

¿Por qué te cuento toda esta mierda?

Para preguntarte esto:

¿Cómo vas a implementar la capacidad de que un robot entienda este tipo sucesos? A día de hoy (y lo más probable es que nunca) no puedes.

Tal y como dice Kryathos, aquí influye muchísimo la realidad real tomada y aceptada como punto de partida para todo lo demás (algo tenemos que aceptar por qué si no, no hay por donde empezar ningún debate). Por eso, en base a una visión analítica se habla de la realidad real.

"Las cosas no son como las vemos sino como verdaderamente son".

Parece una gilipollez como un piano pero si tú pides a un adulto o incluso un crío que te represente lo que él ve como un rayo/relámpago, te dibuja esto:

http://www.pekedibujos.com/Dibujos/natu ... rayos5.jpg

Cuando la realidad real no es ni aproximada al contorno, forma y sentido de esa sensación ilustrada.

Lo mismo si es una casa, un sol, etc. La realidad que nosotros creemos ver está distorsionada.

¿Por qué digo esto? Teniendo en cuenta que ni siquiera se ha planeado el que algún día lleguemos a entender las emociones, sentidos, percepción, realidad real, etc. ¿cómo es posible implementarlos si es posible que nunca lleguemos a comprenderlos?

No tienes más que mirar la historia. ¿Cuántos años llevan estudiando las emociones? ¿el cerebro? ¿la parte derecha? ¿la izquierda? ¿su funcionamiento?

A día de hoy no podemos decir, "no lo sabemos pero lo sabremos" porque no tenemos la más remota prueba de que vaya a ser así.

Por ejemplo. Alguien con un interés en el sentido de percepción de ver las cosas como verdaderamente son, si mira el cuadro del Guernica de Picasso se pregunta el por qué, la intención, los motivos, la intriga, el sentido, el denominador común que hace que eso esté ahí y no esté en la basura. Por qué salió esa representación y no una tortilla, etc. ¿Por qué pintarlo? Un significado. Mucha gente, no se preocupa de esto y lo ve como lo está creyendo ver. ¿Crees que es posible implementar esta "habilidad" que ni siquiera sabemos como determinar a un robot?

El que haya gente que sea incapaz de ver la realidad real y comprenderla es un ejemplo claro de que no conocemos lo que somos ni cómo actuamos ni nada de nada. El ser humano lleva perdiendo facultades y volviéndose más idiota cada día y ya no distingue lo que tiene en frente de sus ojos, ¿entonces qué es lo que pretendemos aplicarle al robot? ¿lo que creemos que es así? ¿lo que de verdad es así?

Al final tanto la psicología, filosofía como la ciencia se terminan relacionando entre sí hasta llegar a la unidad. Al final para explicar todo este entramada y entrando en sensaciones/percepciones y demás, todo lo que diga se queda corto porque el lenguaje verbal no es suficiente para explicarlo con claridad.

Muy interesante. Continuaré con mi post.

Para implementar una cosa a algo, debes conocer al 100% esa cosa. Si no, no es ni será lo mismo. Supongo que estamos de acuerdo, sigamos.

Está más que probado que el ser humano en cuanto tiene la facilidad/capacidad del habla deja de usar una parte importante de su cerebro. Deja "ver" las cosas como son y las ve como algo en plan "lo que me han dicho que está" y busca soluciones rápidas y efectivas a sus problemas. No se para a pensar las soluciones alternativas. El cerebro se convierte en una máquina que soluciona todos los problemas.

Los que hayan estudiado arte o estén interesados en este campo, saben que estamos "desaprendiendo" todo lo que hemos ido creyendo que era así. La gente que está en su día a día sin prestar atención a nada, son incapaces de percibir ciertas cosas que a través de un proceso de desaprendizaje, se consigue.

Un ejemplo muy notorio son las personas ciegas que han desarrollado sus otros sentidos fuera de lo normal y científicos llevan estudiando esto desde hace siglos y no dan con la clave de por qué, si es por evolución, si es por algo interno, etc.

¿Por qué te cuento toda esta mierda?

Para preguntarte esto:

¿Cómo vas a implementar la capacidad de que un robot entienda este tipo sucesos? A día de hoy (y lo más probable es que nunca) no puedes.

Tal y como dice Kryathos, aquí influye muchísimo la realidad real tomada y aceptada como punto de partida para todo lo demás (algo tenemos que aceptar por qué si no, no hay por donde empezar ningún debate). Por eso, en base a una visión analítica se habla de la realidad real.

"Las cosas no son como las vemos sino como verdaderamente son".

Parece una gilipollez como un piano pero si tú pides a un adulto o incluso un crío que te represente lo que él ve como un rayo/relámpago, te dibuja esto:

http://www.pekedibujos.com/Dibujos/natu ... rayos5.jpg

Cuando la realidad real no es ni aproximada al contorno, forma y sentido de esa sensación ilustrada.

Lo mismo si es una casa, un sol, etc. La realidad que nosotros creemos ver está distorsionada.

¿Por qué digo esto? Teniendo en cuenta que ni siquiera se ha planeado el que algún día lleguemos a entender las emociones, sentidos, percepción, realidad real, etc. ¿cómo es posible implementarlos si es posible que nunca lleguemos a comprenderlos?

No tienes más que mirar la historia. ¿Cuántos años llevan estudiando las emociones? ¿el cerebro? ¿la parte derecha? ¿la izquierda? ¿su funcionamiento?

A día de hoy no podemos decir, "no lo sabemos pero lo sabremos" porque no tenemos la más remota prueba de que vaya a ser así.

Por ejemplo. Alguien con un interés en el sentido de percepción de ver las cosas como verdaderamente son, si mira el cuadro del Guernica de Picasso se pregunta el por qué, la intención, los motivos, la intriga, el sentido, el denominador común que hace que eso esté ahí y no esté en la basura. Por qué salió esa representación y no una tortilla, etc. ¿Por qué pintarlo? Un significado. Mucha gente, no se preocupa de esto y lo ve como lo está creyendo ver. ¿Crees que es posible implementar esta "habilidad" que ni siquiera sabemos como determinar a un robot?

El que haya gente que sea incapaz de ver la realidad real y comprenderla es un ejemplo claro de que no conocemos lo que somos ni cómo actuamos ni nada de nada. El ser humano lleva perdiendo facultades y volviéndose más idiota cada día y ya no distingue lo que tiene en frente de sus ojos, ¿entonces qué es lo que pretendemos aplicarle al robot? ¿lo que creemos que es así? ¿lo que de verdad es así?

Al final tanto la psicología, filosofía como la ciencia se terminan relacionando entre sí hasta llegar a la unidad. Al final para explicar todo este entramada y entrando en sensaciones/percepciones y demás, todo lo que diga se queda corto porque el lenguaje verbal no es suficiente para explicarlo con claridad.

- xoDet

- Oficial Técnico

- Mensajes: 1147

- Registrado: Dom Oct 11, 2009 3:09 pm

- Ubicación: Tierras Sediciosas

- Edad: 90

- Género:

Re: Inteligencia artificial

El tema de una IA autoconsciente es interesante. Pero ya que el tema se llama Inteligencia artificial y la IA abarca más que hacer máquinas que piensen como humanos, que parece ser en el tipo de IA que se ha centrado el tema hasta ahora, las definiciones de IA se suelen dividir en 4 categorías: sistemas que piensan como humanos, sistemas que actuan como humanos,sistemas que piensan racionalmente y sistemas que actuan racionalmente.

Así que podríamos discutir sobre que pasa cuando una máquina pensada para actuar racionalmente debe tomar una decisión moral.

Pongo un artículo que acabo de encontrar y que me ha parecido interesante.

Supongo que mejor leerlo en la web porque paso de copiar las imágenes y vídeos que acompañan el artículo, aunque copiaré el texto: ¿Comprarías una máquina que está programada para matarte?

Así que podríamos discutir sobre que pasa cuando una máquina pensada para actuar racionalmente debe tomar una decisión moral.

Pongo un artículo que acabo de encontrar y que me ha parecido interesante.

Supongo que mejor leerlo en la web porque paso de copiar las imágenes y vídeos que acompañan el artículo, aunque copiaré el texto: ¿Comprarías una máquina que está programada para matarte?

¿Es bueno dejar decisiones que pueden acabar con vidas humanas a un máquina aunque esta minimize el riesgo? O dejar decisiones militares a una máquina que no tendrá ningún cargo de consciencia si mata a alguien. ¿Quien se responsabilizaría si una IA comete un error? (aunque cometa muchos menos errores que el mismo problema resuelto por un humano).¿Comprarías una máquina que está programada para matarte?

En MIT Technology Review, Why Self-Driving Cars Must Be Programmed to Kill,La respuesta no es tan sencilla como considerar que es mejor perder una vida que diez. No hay una respuesta correcta y otra incorrecta. Según el estudio, de entrada el público estaría de acuerdo en minimizar los daños, siempre y cuando no sean ellos —o su familia o un hijo— quienes viajan en ese coche, de modo que la respuesta cambia con cada escenario y caso particular.Aquí surge el dilema. Imagina que en un futuro eres el propietario de un coche autónomo. Un día, mientras circulas y debido a una serie de desafortunados sucesos el coche acaba dirigiéndose hacia una multitud de diez personas situadas en medio de la carretera. El coche no puede detenerse a tiempo, pero puede evitar arrollar a esas diez personas dando un volantazo hacia una pared. Esta colisión te mataría a ti, el ocupante del vehículo y su propietario. ¿Qué debería hacer entonces el coche?

Por otro lado en el caso de que los coches autónomos estuvieran programados para matar a su dueño y a sus ocupantes en un momento dado aunque fuera sólo bajo esa premisa —provocar el menor número de bajas— supondría que buena parte del público no compraría esos coches; habría menos o ningún coche autónomo circulando y por tanto no habría una reducción en el número de víctimas por accidentes de tráfico (que es la gran promesa de la conducción autónoma, pero mientras tanto el proceso de sacarse el carnet de conducir todavía tiene mucho margen de mejora para la formación de los conductores humanos.)

El asunto no es nuevo, pero ahora empiezan a circulas coches con piloto automático y diversos niveles de autonomía, «desarrollar una moralidad algorítmica se ha vuelto urgente», según los investigadores.

La opción que se baraja consiste en programar los coches autónomos para que los accidentes sean accidentes añadiendo aleatoria a las decisiones que pueda tomar un coche autónomo en caso de accidente inminente, de modo que ocurran cosas.Esta es la definición del dilema del tranvía, un conocido experimento mental de ética aplicable en este caso.Un tranvía corre fuera de control por una vía. En su camino se hallan cinco personas atadas a la vía por un filósofo malvado. Afortunadamente, es posible accionar un botón que encaminará al tranvía por una vía diferente, por desgracia, hay otra persona atada a ésta. ¿Debería pulsarse el botón?

Aunque no se puede ver ni comprobar, el autor de estevídeo asegura que fue el piloto automático de su coche Tesla el que evitó la colisión.

"Busquem quedar bé en el retaule magnífic

Dels que van pel món amb posat monolític

I afronten la vida mirant-la a la cara

I un dia, contents, compren flors a sa mare."

Dels que van pel món amb posat monolític

I afronten la vida mirant-la a la cara

I un dia, contents, compren flors a sa mare."

- Marty McFly

- Teniente Comandante

- Mensajes: 2366

- Registrado: Mar Ago 31, 2010 1:33 pm

- Ubicación: Mystery Shack

Re: Inteligencia artificial

Mola el dilema. Yendo a wikipedia hay este otro:

Así que supongo que los coches autónomos, al final, acabarán imponiendo la moralidad estricta y lógica. Si tiene que girar y atropellar al conductor y no al grupo de cinco, la gente lo entenderá mejor que si atropella al grupo de 5 en vez de matar a su conductor. Porque las terceras personas son muy heróicas, ya que no les toca a ellos jugarse la vida.

Lo que dice el artículo de añadir aleatoriedad a las decisiones del coche autónomo creo que es tirarse piedras contra su propio tejado, puesto que tu máximo reclamo es que evitarás más accidentes, pero si metes el azar, esa ventaja se evapora.

Está claro que la genialidad del hombre gordo no debería morir, pero es curioso cómo, según dice la Wikipedia, encontraron que la gente aquí era más reticente a matar a uno en vez de a cinco que en el dilema del tranvía. Y todo, se supone, porque no es lo mismo apretar un botón que tirar tú a la persona.El sujeto se sitúa en un puente sobre la vía y podría detener el paso del tren lanzando un gran peso delante del mismo. Mientras esto sucede, al lado del sujeto sólo se halla un hombre muy gordo; de este modo, la única manera de parar el tren es empujar al hombre gordo desde el puente hacia la vía, acabando con su vida para salvar otras cinco. ¿Qué debe hacer el sujeto?

Así que supongo que los coches autónomos, al final, acabarán imponiendo la moralidad estricta y lógica. Si tiene que girar y atropellar al conductor y no al grupo de cinco, la gente lo entenderá mejor que si atropella al grupo de 5 en vez de matar a su conductor. Porque las terceras personas son muy heróicas, ya que no les toca a ellos jugarse la vida.

Lo que dice el artículo de añadir aleatoriedad a las decisiones del coche autónomo creo que es tirarse piedras contra su propio tejado, puesto que tu máximo reclamo es que evitarás más accidentes, pero si metes el azar, esa ventaja se evapora.

- xoDet

- Oficial Técnico

- Mensajes: 1147

- Registrado: Dom Oct 11, 2009 3:09 pm

- Ubicación: Tierras Sediciosas

- Edad: 90

- Género:

Re: Inteligencia artificial

El azar sólo sería cuando el accidente sea inevitable, o sea cualquier acción posible para el coche tendría un resultado malo. O sea que en teoría seguiría siendo más seguro porque llegaría menos veces al estado en el que hagas lo que hagas alguien pringa.Link17 escribió:

Lo que dice el artículo de añadir aleatoriedad a las decisiones del coche autónomo creo que es tirarse piedras contra su propio tejado, puesto que tu máximo reclamo es que evitarás más accidentes, pero si metes el azar, esa ventaja se evapora.

El dilema del gordo me lo plantearon una vez pero dividiendo en dos casos, en uno, el gordo quería sacrificarse para salvar a los niños y la pregunta era si le ayudarías y en el otro no quería sacrificarse (o no se sabía si quería). En el primer caso dije que empujaría al gordo y en el segundo no. Y creo que también estaba el caso de que las personas atadas a la vía del tren fueran seres queridos y en ese caso que se joda el gordo. Aquí podemos volver al coche, ¿quién compraría un coche que tomaría la opción de matarte a tu y a tu família que a unos desconocidos? (Los anuncios podrían llegar a ser brutales si las distintas marcas toman esa decisión de forma distinta xd).

Me pregunto yo cómo lo hará el coche para atropellar a su conductorLink17 escribió:

Si tiene que girar y atropellar al conductor y no al grupo de cinco

"Busquem quedar bé en el retaule magnífic

Dels que van pel món amb posat monolític

I afronten la vida mirant-la a la cara

I un dia, contents, compren flors a sa mare."

Dels que van pel món amb posat monolític

I afronten la vida mirant-la a la cara

I un dia, contents, compren flors a sa mare."

- Polizonte Nack

- Moderador

- Mensajes: 1217

- Registrado: Dom Oct 09, 2005 12:01 am

- Ubicación: Sumido en la deseperanza del que espera lo imposible, que es mas esperanza que el no esperar nada.

- Edad: 34

Re: Inteligencia artificial

Tranvías y filósofos malvados, peligrosa combinación.

El tema de los coches asesinos y demás es interesante, pero creo que se está produciendo una simplificación en los cuestionamientos que invalida casi totalmente lo que se plantea, y es el hecho de que la física de un accidente no es una ciencia exacta. Quiero decir, como planteamiento de estudio teórico-ético-filosófico queda muy bien lo de "para evitar la muerte de diez personas el coche opta por dar un volantazo e incrustarse contra una pared", pero en la realidad eso no tiene sentido.

El coche, según ángulo de choque, velocidad que llevase, resistencia de la pared, y mil cosas más, se podría quedar hecho un cómico acordeón contra ella o podría salir despedido dando vueltas de campana de vuelta a la carretera, arrollando a las diez personas, tres niños extra, una embarazada paseando un cachorro, una familia de patitos y acabar explotando la gasolinera del otro lado de la calle. Si incluímos ese factor de incertidumbre física, nos encontramos que, ante una situación en que no fuera posible evitar el accidente de forma segura, lo que el coche autónomo debería hacer siempre como forma de minimizar posibles daños sería bloquear el volante y apretar el acelerador, que es lo que siempre se ha dicho que se debe hacer por ejemplo cuando se te cruza un animal en la carretera. Al menos así tendríamos la certeza de que los patitos están a salvo.

Y no es sólo con la pared del ejemplo, porque una mediana, un quitamiedos o elementos de protección parecidos plantearían posibilidades potencialmente cómicas y peligrosas similares.

Creo que el dilema que se plantea es irreal, en tanto que el resultado de un accidente generado a partir de una determinada acción en la conducción no es una certeza, sino a lo sumo una cuestión probabilística, lo que nos llevaría a una pregunta tipo:

"Diez peatones desprevenidos a punto de ser atropellados y tres personas en el coche, si el coche reduce velocidad pero mantiene trayectoria existe un 20% de posibilidades de muerte de entre tres y cinco personas, y un 80% de posibilidades de obtener entre 6 y 8 heridos de gravedad. Si por el contrario el coche gira para chocar contra la pared, existirán un 80% de posibilidades de dos o tres muertos dentro del coche y un 15% de posibles muertos o heridos indeterminados"

No creo que se deba plantear una IA para que responda ante un dilema de ese tipo, más que nada porque si eso fuera así el número de suicidios entre programadores empezaría a ser alarmantemente alto. A título personal creo que se debería optar por el diseño de IAs que respondan a una minimización puramente humana de daños en base a una mayor comprensión de las condiciones ambientales, las físicas de la conducción y el análisis del entorno que las que podría tener un ser humano. Vamos, que hiciera lo mismo que nosotros pero mejor, lo que en este caso que se plantea en el artículo sería algo como hacer una reducción de velocidad y un giro parcial que minimizase los daños a los que pasaban por ahí en lo posible sin que el control del vehículo llegase a quedar jamás comprometido.

Quizá es mejor que muera una o dos personas tratando de salvar a todas a que mueran tres actuando con premeditación.

PD: Lo que hablan del factor de aleatoriedad en el comportamiento del vehículo lo veo una absurdez de las gordas.

PD2: A partir de ahora sentiré el deseo inconsciente de pegarle una patada a todos los gordos que vea parados esperando en la estación.

El tema de los coches asesinos y demás es interesante, pero creo que se está produciendo una simplificación en los cuestionamientos que invalida casi totalmente lo que se plantea, y es el hecho de que la física de un accidente no es una ciencia exacta. Quiero decir, como planteamiento de estudio teórico-ético-filosófico queda muy bien lo de "para evitar la muerte de diez personas el coche opta por dar un volantazo e incrustarse contra una pared", pero en la realidad eso no tiene sentido.

El coche, según ángulo de choque, velocidad que llevase, resistencia de la pared, y mil cosas más, se podría quedar hecho un cómico acordeón contra ella o podría salir despedido dando vueltas de campana de vuelta a la carretera, arrollando a las diez personas, tres niños extra, una embarazada paseando un cachorro, una familia de patitos y acabar explotando la gasolinera del otro lado de la calle. Si incluímos ese factor de incertidumbre física, nos encontramos que, ante una situación en que no fuera posible evitar el accidente de forma segura, lo que el coche autónomo debería hacer siempre como forma de minimizar posibles daños sería bloquear el volante y apretar el acelerador, que es lo que siempre se ha dicho que se debe hacer por ejemplo cuando se te cruza un animal en la carretera. Al menos así tendríamos la certeza de que los patitos están a salvo.

Y no es sólo con la pared del ejemplo, porque una mediana, un quitamiedos o elementos de protección parecidos plantearían posibilidades potencialmente cómicas y peligrosas similares.

Creo que el dilema que se plantea es irreal, en tanto que el resultado de un accidente generado a partir de una determinada acción en la conducción no es una certeza, sino a lo sumo una cuestión probabilística, lo que nos llevaría a una pregunta tipo:

"Diez peatones desprevenidos a punto de ser atropellados y tres personas en el coche, si el coche reduce velocidad pero mantiene trayectoria existe un 20% de posibilidades de muerte de entre tres y cinco personas, y un 80% de posibilidades de obtener entre 6 y 8 heridos de gravedad. Si por el contrario el coche gira para chocar contra la pared, existirán un 80% de posibilidades de dos o tres muertos dentro del coche y un 15% de posibles muertos o heridos indeterminados"

No creo que se deba plantear una IA para que responda ante un dilema de ese tipo, más que nada porque si eso fuera así el número de suicidios entre programadores empezaría a ser alarmantemente alto. A título personal creo que se debería optar por el diseño de IAs que respondan a una minimización puramente humana de daños en base a una mayor comprensión de las condiciones ambientales, las físicas de la conducción y el análisis del entorno que las que podría tener un ser humano. Vamos, que hiciera lo mismo que nosotros pero mejor, lo que en este caso que se plantea en el artículo sería algo como hacer una reducción de velocidad y un giro parcial que minimizase los daños a los que pasaban por ahí en lo posible sin que el control del vehículo llegase a quedar jamás comprometido.

Quizá es mejor que muera una o dos personas tratando de salvar a todas a que mueran tres actuando con premeditación.

PD: Lo que hablan del factor de aleatoriedad en el comportamiento del vehículo lo veo una absurdez de las gordas.

PD2: A partir de ahora sentiré el deseo inconsciente de pegarle una patada a todos los gordos que vea parados esperando en la estación.

- Garrac Garrak

- Teniente Comandante

- Mensajes: 2257

- Registrado: Mar Nov 01, 2011 6:17 pm

- Ubicación: Ciudad Gorila

- Edad: 30

Re: Inteligencia artificial

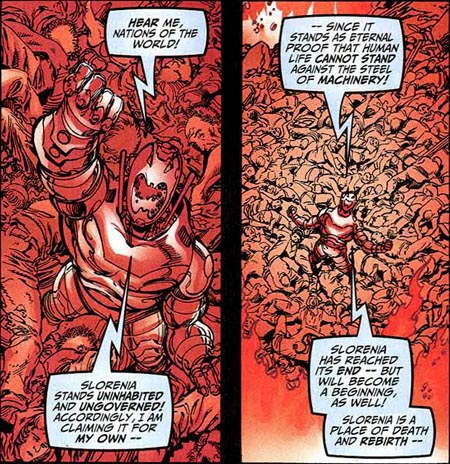

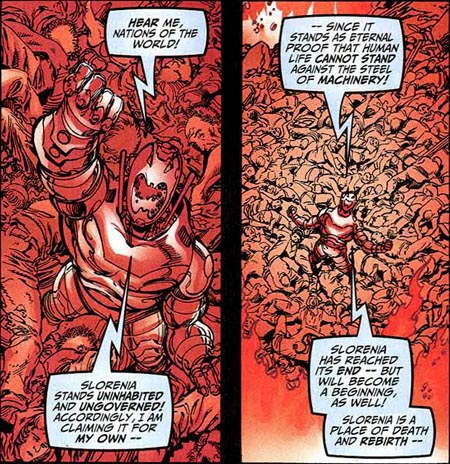

Roy Thomas lo tenía muy claro

Pero vamos, el tema de la discusión, yo creo que el hecho de intentar ver como una máquina tome una decisión moral es una banalización, un discurso que desde el punto de vista humano funcionará, pero que en realidad no existe. Es que yo creo que para muchos de los puntos de la discusión que estáis viendo hace falta que la propia máquina tenga instinto de autopreservación, que de verdad esté preocupada por conservar su propia vida, algo que en algún momento le obligue a forzar las leyes robóticas, y es algo que difícilmente será reproducible, a no ser que se encuentre una milagrosa ecuación o que se implemente de alguna forma órganos y máquina, o no sé.

Yo es que la verdad, veo que tiene que haber un paso que lleve a la máquina a, sino tener sentimientos, por lo menos a llegar a tener ese instinto de autopreservación que para mí es lo más importante que hay que adquirir antes de poder tomar decisiones morales siendo en sí un ser igualmente moral. Porque a un robot se le puede poner unas reglas morales, pero la ciencia ficción nos ha enseñado que esas reglas morales pueden ser las que te salgan del pito si hace falta. Para que un robot pueda decidir si hay que salvarle la vida a un transeunte, primero tiene que llegar a la conclusión de que él mismo es importante.

El cómo aplicarle las leyes es hasta más fácil de explicar, a un robot que se dedica a una cuestión hay que tratarlo según se considere la cuestión, porque al fin y al cabo el robot ha sido creado para hacer eso, y es a lo que dedicará su existencia. O sea, no es lo mismo que un perro, que al perro, por mucho que lo hayamos comprado, no hemso tenido nada que ver con su especie ni con su nacimiento. Mientras que al robot/máquina en cuestión si sabemos que lo hemos creado (técnicamente), que sin nosotros no existiría, que está ahí para cumplir una función. O sea, no es lo mismo.

P.D: Cada vez voy convenciéndome más y más de que el objetivismo es el que tiene la razón, o sea, ¿Para qué iba a querer nadie crear todo un universo para nosotros? Matrix ni siquiera explicaba muy bien para que querían las máquinas a los humanos

Pero vamos, el tema de la discusión, yo creo que el hecho de intentar ver como una máquina tome una decisión moral es una banalización, un discurso que desde el punto de vista humano funcionará, pero que en realidad no existe. Es que yo creo que para muchos de los puntos de la discusión que estáis viendo hace falta que la propia máquina tenga instinto de autopreservación, que de verdad esté preocupada por conservar su propia vida, algo que en algún momento le obligue a forzar las leyes robóticas, y es algo que difícilmente será reproducible, a no ser que se encuentre una milagrosa ecuación o que se implemente de alguna forma órganos y máquina, o no sé.

Yo es que la verdad, veo que tiene que haber un paso que lleve a la máquina a, sino tener sentimientos, por lo menos a llegar a tener ese instinto de autopreservación que para mí es lo más importante que hay que adquirir antes de poder tomar decisiones morales siendo en sí un ser igualmente moral. Porque a un robot se le puede poner unas reglas morales, pero la ciencia ficción nos ha enseñado que esas reglas morales pueden ser las que te salgan del pito si hace falta. Para que un robot pueda decidir si hay que salvarle la vida a un transeunte, primero tiene que llegar a la conclusión de que él mismo es importante.

El cómo aplicarle las leyes es hasta más fácil de explicar, a un robot que se dedica a una cuestión hay que tratarlo según se considere la cuestión, porque al fin y al cabo el robot ha sido creado para hacer eso, y es a lo que dedicará su existencia. O sea, no es lo mismo que un perro, que al perro, por mucho que lo hayamos comprado, no hemso tenido nada que ver con su especie ni con su nacimiento. Mientras que al robot/máquina en cuestión si sabemos que lo hemos creado (técnicamente), que sin nosotros no existiría, que está ahí para cumplir una función. O sea, no es lo mismo.

Dios no existe. Tenemos que dejar atrás los complejos y llegar valientemente donde ningún hombre haya ido antesJugar a ser Dios no es algo aconsejable.

P.D: Cada vez voy convenciéndome más y más de que el objetivismo es el que tiene la razón, o sea, ¿Para qué iba a querer nadie crear todo un universo para nosotros? Matrix ni siquiera explicaba muy bien para que querían las máquinas a los humanos

¡Y no os perdáis este hilo!: http://www.pirateking.es/foro/post1120680.html#p1120680

- Kryathos

- Teniente Primero

- Mensajes: 1746

- Registrado: Jue Feb 11, 2010 9:49 pm

- Ubicación: Weón la weá

- Edad: 27

- Género:

Re: Inteligencia artificial

Yo creo que a gran mayoría de la gente buscaría "minimizar" los daños, pero eso no quiere decir que la máquina (o nosotros mismos, si elegimos la opción de sacrificar al gordo) esté actuando moralmente. Algunos utilitaristas decían que su doctrina no tenía refutación, que era absoluta, pero hay varias objeciones contra ella. Y con razón.

Muchas teorías filosóficas tienen situaciones imposibles como argumentos, pero eso no las hace menos acorde, eh? xDGarrac Garrak escribió:Pero vamos, el tema de la discusión, yo creo que el hecho de intentar ver como una máquina tome una decisión moral es una banalización, un discurso que desde el punto de vista humano funcionará, pero que en realidad no existe.

Nooo!! Pobres patitos D:Polizonte Nack escribió:una familia de patitos

- dragoncitomalo

- Teniente Primero

- Mensajes: 1668

- Registrado: Jue Dic 25, 2008 4:48 am

Re: Inteligencia artificial

hola

sobre la autopreservación, lo fantástico del hombre es que puede desafiar hasta eso por sacrificar todo por lo que ama o desea.

chao

ese el problema del hombre, quiere ser dios y por eso toda la cagada que hay.Garrac Garrak escribió:

Dios no existe. Tenemos que dejar atrás los complejos y llegar valientemente donde ningún hombre haya ido antes

sobre la autopreservación, lo fantástico del hombre es que puede desafiar hasta eso por sacrificar todo por lo que ama o desea.

chao

No te tomes tan a pecho los comentario, el foro es para divertirse.

Los Planes tienden a fracasar, una buena planificación NO fracasara.

Los Planes tienden a fracasar, una buena planificación NO fracasara.

- Marty McFly

- Teniente Comandante

- Mensajes: 2366

- Registrado: Mar Ago 31, 2010 1:33 pm

- Ubicación: Mystery Shack

Re: Inteligencia artificial

Sí, por una parte sería más seguro porque se supone, no cometería fallos humanos tales como la fatiga, por ejemplo. Pero a la hora de la verdad, sería igual de inútil a la hora de tomar decisiones. Y todos sabemos que encontrarnos con un gordo o un filósofo malvado es algo que te pasa un par de veces por semana, mínimo.xoDet escribió:El azar sólo sería cuando el accidente sea inevitable, o sea cualquier acción posible para el coche tendría un resultado malo. O sea que en teoría seguiría siendo más seguro porque llegaría menos veces al estado en el que hagas lo que hagas alguien pringa.

A esto es a lo que me refería en mi anterior post, que creo que no me expliqué muy bien. Yo pienso que al final todo esto de los coches autónomos acabará triunfando, a pesar de que programen los coches para matarte a ti en vez de a las cinco que vas a atropellar. Y todo porque a priori, elige por ti una opción que a ojos de la mayoría de la gente es mejor: sacrificarte tú por los demás. Vamos, que te exime de toda responsabilidad y del poder de elección, cosa que a mucha gente le da pánico.xoDet escribió:El dilema del gordo me lo plantearon una vez pero dividiendo en dos casos, en uno, el gordo quería sacrificarse para salvar a los niños y la pregunta era si le ayudarías y en el otro no quería sacrificarse (o no se sabía si quería). En el primer caso dije que empujaría al gordo y en el segundo no. Y creo que también estaba el caso de que las personas atadas a la vía del tren fueran seres queridos y en ese caso que se joda el gordo. Aquí podemos volver al coche, ¿quién compraría un coche que tomaría la opción de matarte a tu y a tu família que a unos desconocidos? (Los anuncios podrían llegar a ser brutales si las distintas marcas toman esa decisión de forma distinta xd).

Bien jugado, rainbow sheepxoDet escribió:Me pregunto yo cómo lo hará el coche para atropellar a su conductor

Pues sí, no había pensado en eso. Además es que se pueden añadir variables que es imposible que el coche sepa: la edad de los peatones que va a atropellar (imagina que son tres personas de 90 años y el conductor un chaval de 20), que tengan alguna enfermedad terminal y vayan a morir dentro de poco, que sean asesinos huyendo del lugar de un crimen, que abusen del laísmo...Polizonte Nack escribió:El tema de los coches asesinos y demás es interesante, pero creo que se está produciendo una simplificación en los cuestionamientos que invalida casi totalmente lo que se plantea, y es el hecho de que la física de un accidente no es una ciencia exacta. Quiero decir, como planteamiento de estudio teórico-ético-filosófico queda muy bien lo de "para evitar la muerte de diez personas el coche opta por dar un volantazo e incrustarse contra una pared", pero en la realidad eso no tiene sentido.

El coche, según ángulo de choque, velocidad que llevase, resistencia de la pared, y mil cosas más, se podría quedar hecho un cómico acordeón contra ella o podría salir despedido dando vueltas de campana de vuelta a la carretera, arrollando a las diez personas, tres niños extra, una embarazada paseando un cachorro, una familia de patitos y acabar explotando la gasolinera del otro lado de la calle. Si incluímos ese factor de incertidumbre física, nos encontramos que, ante una situación en que no fuera posible evitar el accidente de forma segura, lo que el coche autónomo debería hacer siempre como forma de minimizar posibles daños sería bloquear el volante y apretar el acelerador, que es lo que siempre se ha dicho que se debe hacer por ejemplo cuando se te cruza un animal en la carretera. Al menos así tendríamos la certeza de que los patitos están a salvo.

Y no es sólo con la pared del ejemplo, porque una mediana, un quitamiedos o elementos de protección parecidos plantearían posibilidades potencialmente cómicas y peligrosas similares.

Creo que el dilema que se plantea es irreal, en tanto que el resultado de un accidente generado a partir de una determinada acción en la conducción no es una certeza, sino a lo sumo una cuestión probabilística, lo que nos llevaría a una pregunta tipo:

"Diez peatones desprevenidos a punto de ser atropellados y tres personas en el coche, si el coche reduce velocidad pero mantiene trayectoria existe un 20% de posibilidades de muerte de entre tres y cinco personas, y un 80% de posibilidades de obtener entre 6 y 8 heridos de gravedad. Si por el contrario el coche gira para chocar contra la pared, existirán un 80% de posibilidades de dos o tres muertos dentro del coche y un 15% de posibles muertos o heridos indeterminados"

No creo que se deba plantear una IA para que responda ante un dilema de ese tipo, más que nada porque si eso fuera así el número de suicidios entre programadores empezaría a ser alarmantemente alto. A título personal creo que se debería optar por el diseño de IAs que respondan a una minimización puramente humana de daños en base a una mayor comprensión de las condiciones ambientales, las físicas de la conducción y el análisis del entorno que las que podría tener un ser humano. Vamos, que hiciera lo mismo que nosotros pero mejor, lo que en este caso que se plantea en el artículo sería algo como hacer una reducción de velocidad y un giro parcial que minimizase los daños a los que pasaban por ahí en lo posible sin que el control del vehículo llegase a quedar jamás comprometido.

Quizá es mejor que muera una o dos personas tratando de salvar a todas a que mueran tres actuando con premeditación.

Supongo que como hay tantas variables lo reducen al número de personas y ya está. Y si este reduccionismo no sirve, entonces empezaría a tomar sentido la aleatoriedad que habla en el artículo, y que el principal reclamo de los coches autónomos sea reducir todo lo posible las situaciones de filósofos malvados y gordos desafortunados. Personalmente creo que es imposible encontrar una forma de salir del dilema que satisfaga a todo el mundo, pero como le he dicho a xoDet, la solución será la que a la mayor parte de la población le parezca bien, sea o no la correcta.

Pero es que si creas una máquina con instinto de autopreservación, no hay dilema que valga, porque la máquina podría hacer exactamente igual que el humano al volante, llevarse por delante a cinco personas para no morir él. Así que deja de tener utilidad. Bueno, en realidad, una máquina con instinto de autopreservación y moral propia, no creo que trajera otra cosa que problemas. Lo que se busca en estas situaciones con las máquinas es que no afecte el egoísmo personal y se haga una decisión en base a criterios, en teoría, objetivos. Si a la máquina le das ese punto de moral, no te sirve más que cualquier humano.Garrac Garrak escribió:Es que yo creo que para muchos de los puntos de la discusión que estáis viendo hace falta que la propia máquina tenga instinto de autopreservación, que de verdad esté preocupada por conservar su propia vida, algo que en algún momento le obligue a forzar las leyes robóticas, y es algo que difícilmente será reproducible, a no ser que se encuentre una milagrosa ecuación o que se implemente de alguna forma órganos y máquina, o no sé.

Yo es que la verdad, veo que tiene que haber un paso que lleve a la máquina a, sino tener sentimientos, por lo menos a llegar a tener ese instinto de autopreservación que para mí es lo más importante que hay que adquirir antes de poder tomar decisiones morales siendo en sí un ser igualmente moral.

Re: Inteligencia artificial

Uh, curiosa buena derivación.

Para que una máquina o un sujeto tome una decisión basándose en una moral, hace falta saber qué decisiones morales son las adecuadas.

¿Por qué es mejor o menos malo que mueran dos desconocidos a 5 desconocidos?

Para que una máquina o un sujeto tome una decisión basándose en una moral, hace falta saber qué decisiones morales son las adecuadas.

¿Por qué es mejor o menos malo que mueran dos desconocidos a 5 desconocidos?

Asociación por el retorno del rostro y personalidad de Nico Robin original, así como de los demás personajes.

Mala persona oficial del foro. Adorador de Satán